OpenClaw插件推荐:lossless-claw|给 OpenClaw 安装上“大脑”

编辑文章为AI总结

项目地址:https://github.com/martian-engineering/lossless-claw

什么是lossless-claw

用一段话给你讲清楚(小白也能懂):

lossless-claw 是一个给 OpenClaw 加“记忆”的插件,它会把你和 AI 的所有对话完整保存下来,并在需要的时候帮 AI 找回来用,这样就不会因为上下文满了而“失忆”,能持续记住你之前说过的内容、做过的项目和配置。

简单点理解就是:

👉 原本 OpenClaw:聊久了就忘(因为上下文会被丢)

👉 装了它之后:有“聊天记录+搜索”,可以一直接着干活

一句更直白的总结:

它不是增强功能,而是让 OpenClaw 从“短期聊天”变成“长期助手”的关键插件。

安装方式

小龙虾自动安装(推荐)

使用小龙虾自动完成安装,将下面的话术发送给小龙虾,安装之前记得给服务器做快照。

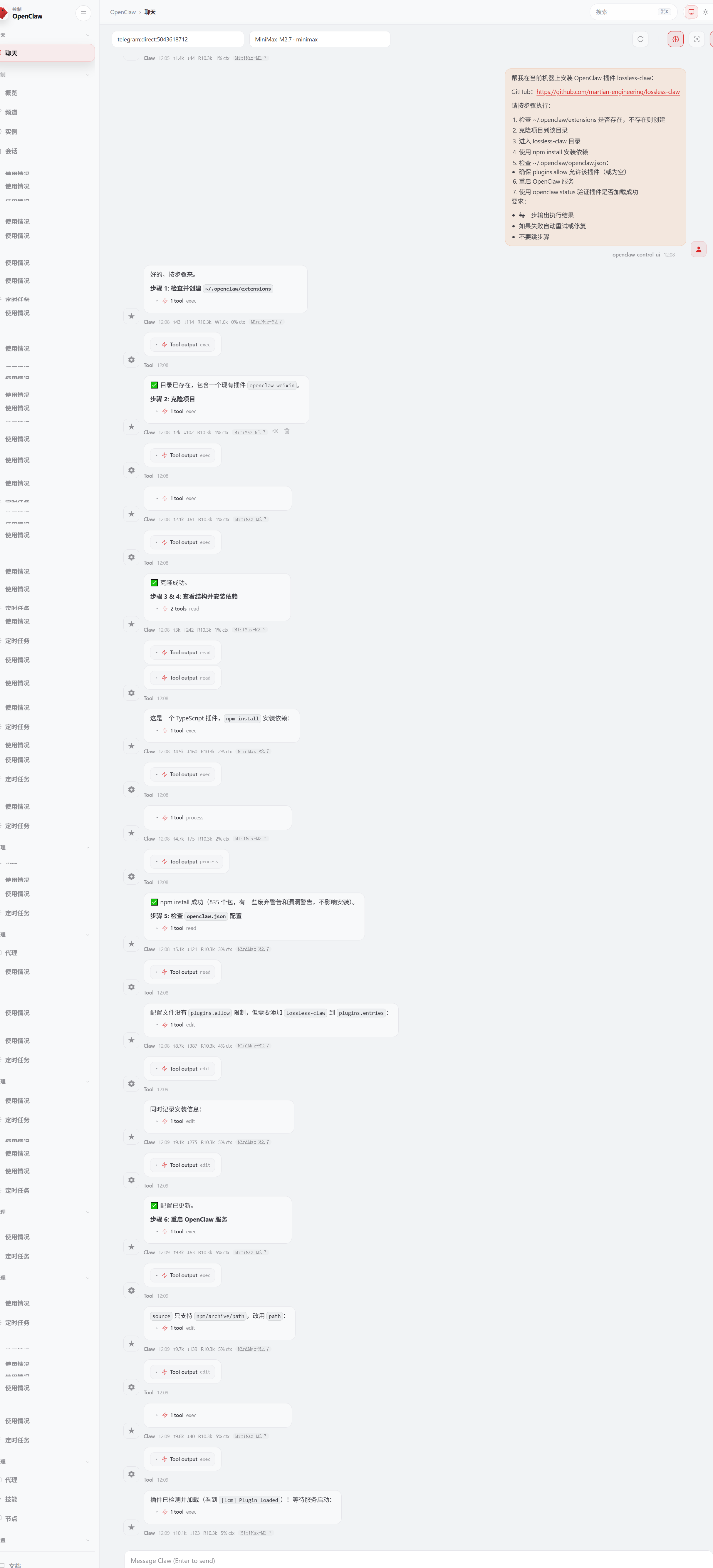

帮我在当前机器上安装 OpenClaw 插件 lossless-claw:

GitHub:https://github.com/martian-engineering/lossless-claw

请按步骤执行:

1. 检查 ~/.openclaw/extensions 是否存在,不存在则创建

2. 克隆项目到该目录

3. 进入 lossless-claw 目录

4. 使用 npm install 安装依赖

5. 检查 ~/.openclaw/openclaw.json:

- 确保 plugins.allow 允许该插件(或为空)

6. 重启 OpenClaw 服务

7. 使用 openclaw status 验证插件是否加载成功

要求:

- 每一步输出执行结果

- 如果失败自动重试或修复

- 不要跳步骤

项目克隆安装

使用项目官方说明安装。

使用 OpenClaw 的插件安装程序:

openclaw plugins install @martian-engineering/lossless-claw如果您是从本地 OpenClaw 检出运行,请使用:

pnpm openclaw plugins install @martian-engineering/lossless-claw对于本地插件开发,请链接您的工作副本,而不是复制文件:

openclaw plugins install --link /path/to/lossless-claw

# or from a local OpenClaw checkout:

# pnpm openclaw plugins install --link /path/to/lossless-claw安装命令会记录插件,启用它,并应用兼容的插槽选择(包括contextEngine适用时)。

配置 OpenClaw

大多数情况下,之后无需手动编辑 JSON openclaw plugins install。

如果需要手动设置,请确保上下文引擎槽指向 lossless-claw:

{

"plugins": {

"slots": {

"contextEngine": "lossless-claw"

}

}

}配置更改后请重启 OpenClaw。

插件配置(进阶)

LCM 的配置是通过插件配置和环境变量相结合的方式实现的。为了向后兼容,环境变量优先。

在 OpenClaw 配置中添加lossless-claw以下条目:plugins.entries

{

"plugins": {

"entries": {

"lossless-claw": {

"enabled": true,

"config": {

"freshTailCount": 32,

"contextThreshold": 0.75,

"incrementalMaxDepth": -1,

"ignoreSessionPatterns": [

"agent:*:cron:**"

],

"summaryProvider": "anthropic",

"summaryModel": "claude-3-5-haiku"

}

}

}

}

}summaryModel并summaryProvider允许您将压缩摘要绑定到比主 OpenClaw 会话模型更便宜或更快的模型。如果未设置,LCM 将使用 OpenClaw 配置的默认模型/提供程序。

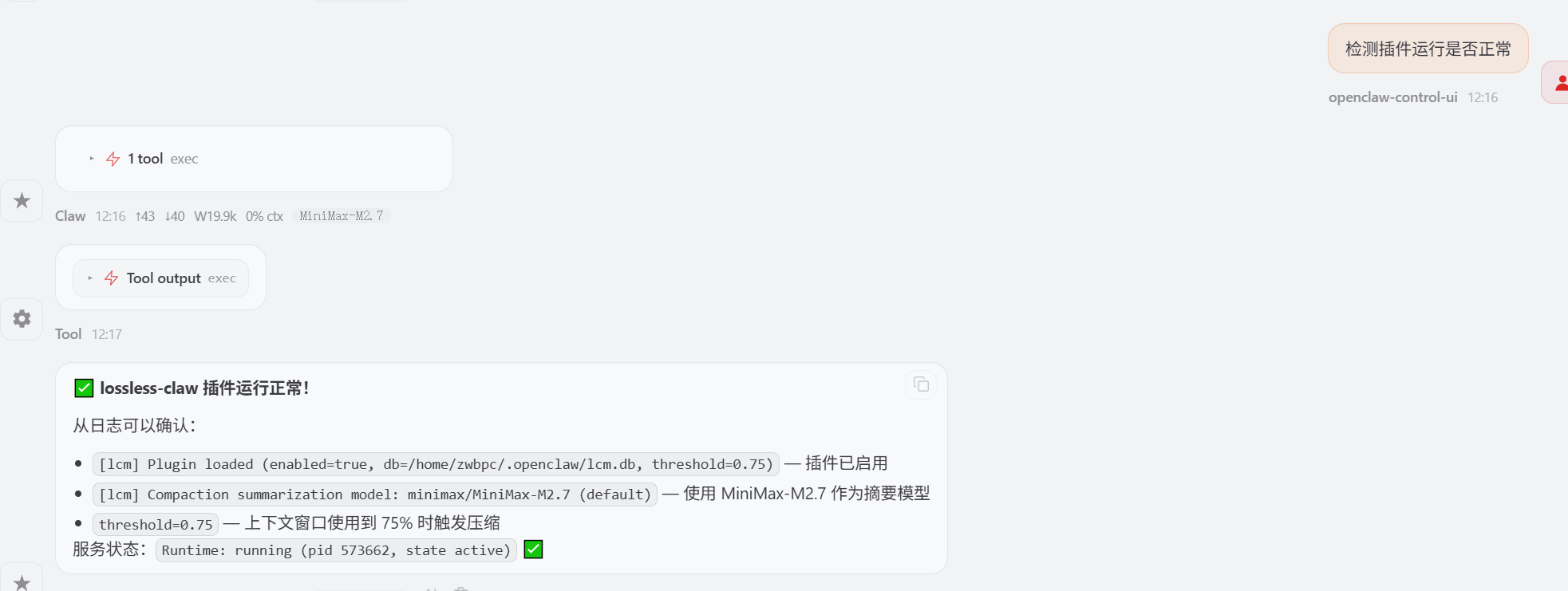

安装完成

- 0

-

分享